澳门科技大学创新工程学院计算机科学与工程学院二年级博士生韩天顺作为第一作者在国际顶级会议ACM International Conference on Multimedia(ACM MM)上发表了题为 “PESTalk: Speech-Driven 3D Facial Animation with Personalized Emotional Styles”(《PESTalk:基于语音驱动的具有个性化情感风格的3D面部动画》)的学术论文。该论文的通信作者为计算机科学与工程学院万军特聘副教授。

韩天顺博士生

ACM MM 是由国际计算机学会(ACM)主办的多媒体领域最具影响力和最高水平的国际顶级学术会议之一,自1993年创办以来,已成为该领域学术界和工业界交流的核心平台,被中国计算机学会(CCF)推荐为计算机图形学与多媒体领域的A类国际学术会议。本届 ACM MM 2025 竞争异常激烈,共收到来自全球的4711篇有效投稿,经过严格的双盲评审,最终仅录用1251篇论文,录用率约为26.6%。这进一步彰显了澳科大在人工智能领域的卓越研究实力。

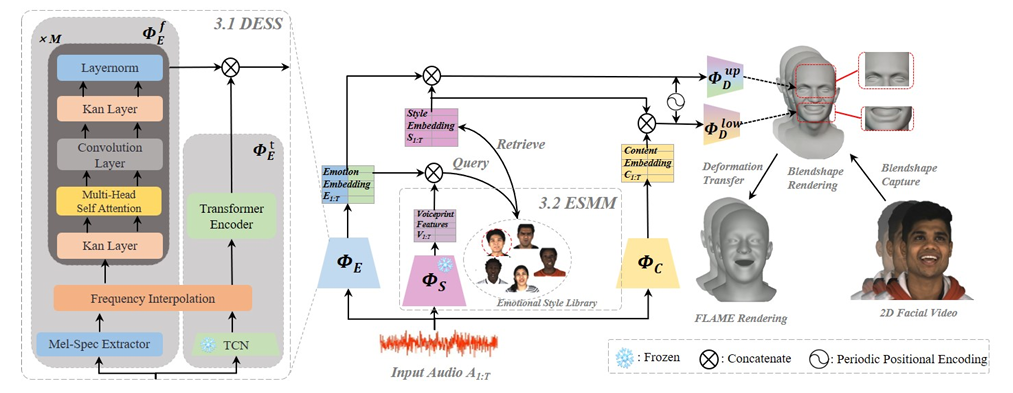

该成果主要研究以语音驱动的 3D 面部动画合成技术,提出一种名为 PESTalk 的方法用于生成具有个性化情感风格的 3D 面部动画。具体来说,该方法主要包含双流情感提取器(DSEE)和情感风格建模模组(ESMM)。前者采用捕捉时域变化与频域特征的双重策略,在处理音频信号的过程中,同时提取细粒度情感特征和细微情感差异,解决相似情感类别区分难题;后者基于声纹特征建立每个主体的基线表征,并通过持续整合情感特征逐步优化,使每个主体在不同情感类别中形成独特的个性化情感风格表征,避免情感表达重复刻板。此外,团队还利用先进面部捕捉模型从 2D 情感数据中提取伪面部混合形状系数,构建大规模 3D 情感化说话人脸数据集(3D-EmoStyle),从而在提升 3D 面部动画真实感的同时,缓解相关数据稀缺问题。

▲ 论文提出的方法整体流程图

该成果对基于语音驱动的3D面部动画研究具有重要价值,通过增强动画的情感真实性与个性化表达,便于在虚拟交互、数字人技术、影视制作等场景中实现自然且生动的面部动画效果,具有广泛的实际应用前景。论文通过理论创新与实验验证,展示了澳科大在计算机视觉与人工智能领域的领先水平。韩天顺作为论文第一作者,其研究成果的发表也体现了澳科大在培养高水平科研人才方面的卓越成就。

澳科大将继续支持前沿科学研究,推动人工智能领域的创新发展,为全球科技进步贡献更多智慧与力量。