澳門科技大學創新工程學院計算機科學與工程學院二年級博士生韓天順作為第一作者在國際頂級會議ACM International Conference on Multimedia(ACM MM)上發表了題為 “PESTalk: Speech-Driven 3D Facial Animation with Personalized Emotional Styles”(《PESTalk:基於語音驅動的具有個性化情感風格的3D面部動畫》)的學術論文。該論文的通信作者為計算機科學與工程學院萬軍特聘副教授。

韩天顺博士生

ACM MM 是由國際計算機學會(ACM)主辦的多媒體領域最具影響力和最高水平的國際頂級學術會議之一,自1993年創辦以來,已成為該領域學術界和工業界交流的核心平台,被中國計算機學會(CCF)推薦為計算機圖形學與多媒體領域的A類國際學術會議。本屆 ACM MM 2025 競爭異常激烈,共收到來自全球的4711篇有效投稿,經過嚴格的雙盲評審,最終僅錄用1251篇論文,錄用率約為26.6%。這進一步彰顯了澳科大在人工智能領域的卓越研究實力。

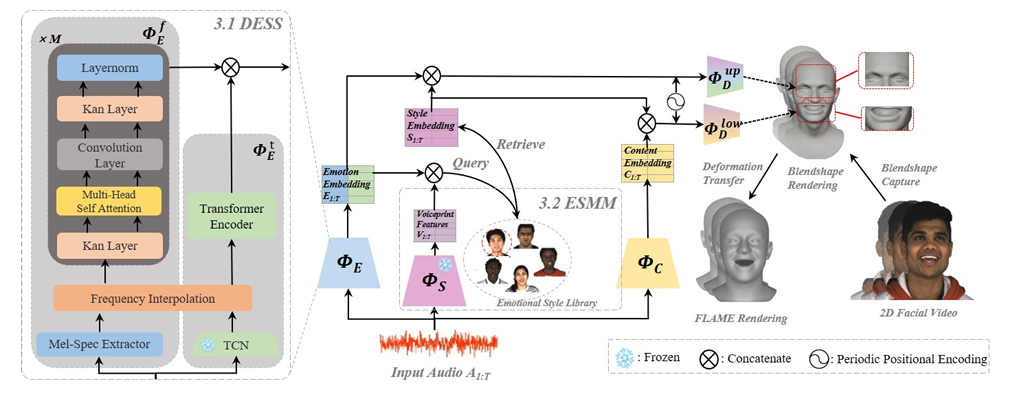

該成果主要研究以語音驅動的 3D 面部動畫合成技術,提出一種名為 PESTalk 的方法用於生成具有個性化情感風格的 3D 面部動畫。具體來說,該方法主要包含雙流情感提取器(DSEE)和情感風格建模模組(ESMM)。前者採用捕捉時域變化與頻域特徵的雙重策略,在處理音頻信號過程中,同時提取細粒度情感特徵和細微情感差異,解決相似情感類別區分難題;後者基於聲紋特徵建立每個主體的基線表征,並通過持續整合情感特徵逐步優化,使每個主體在不同情感類別中形成獨特的個性化情感風格表征,避免情感表達重複刻板。此外,團隊還利用先進面部捕捉模型從 2D 情感數據中提取偽面部混合形狀係數,構建大規模 3D 情感化說話人臉數據集(3D-EmoStyle),從而在提升 3D 面部動畫真實感的同時,緩解相關數據稀缺問題。

▲ 論文提出的方法整體流程圖

該成果對基於語音驅動的3D面部動畫研究具有重要價值,通過增強動畫的情感真實性與個性化表達,便於在虛擬交互、數字人技術、影視製作等場景中實現自然且生動的面部動畫效果,具有廣泛的實際應用前景。論文通過理論創新與實驗驗證,展示了澳科大在計算機視覺與人工智能領域的領先水平。韓天順作為論文第一作者,其研究成果的發表也體現了澳科大在培養高水平科研人才方面的卓越成就。

澳科大將繼續支持前沿科學研究,推動人工智能領域的創新發展,為全球科技進步貢獻更多智慧與力量。